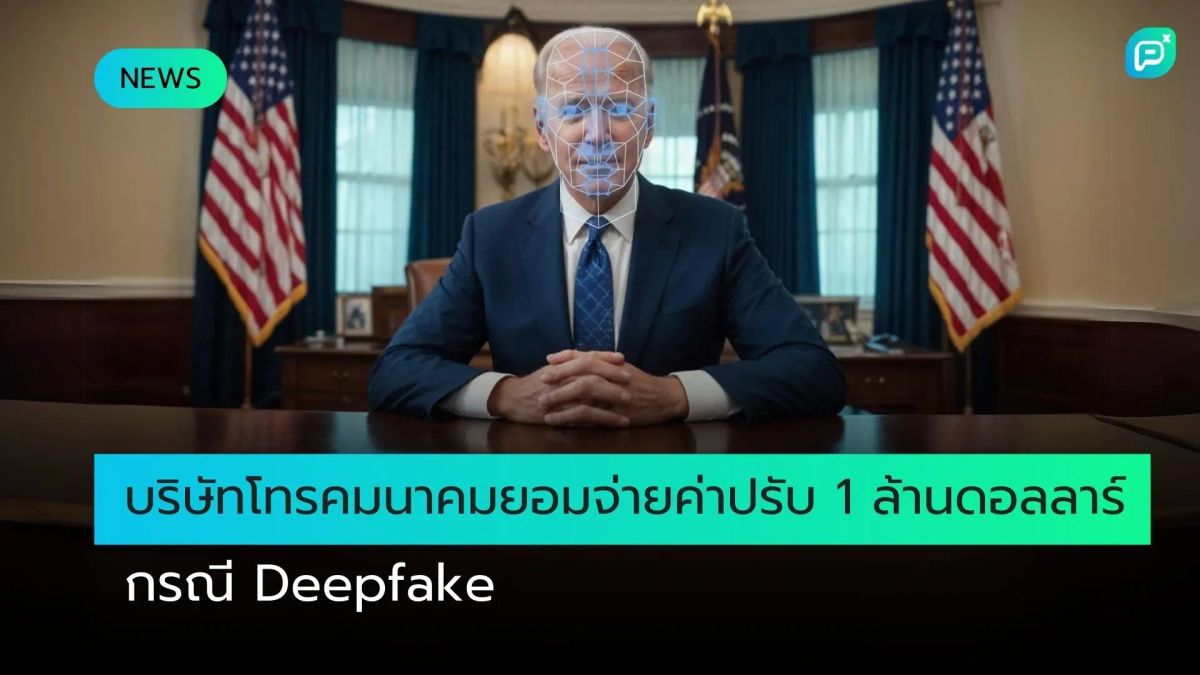

บริษัทโทรคมนาคมยอมจ่ายค่าปรับ 1 ล้านดอลลาร์ กรณีDeepfake

บริษัทโทรคมนาคมจ่ายค่าปรับ 1 ล้านดอลลาร์ หลังใช้ Deepfake ปลอมเสียงประธานาธิบดี Biden ในการรณรงค์ทางการเมือง

Key takeaway

- บริษัทโทรคมนาคม Lingo Telecom ยอมจ่ายค่าปรับ 1 ล้านดอลลาร์สหรัฐฯ จากการใช้ Deepfake Robocall ปลอมเสียงประธานาธิบดี Joe Biden

- FCC เน้นย้ำความสำคัญของการแจ้งผู้บริโภคอย่างชัดเจนเมื่อมีการใช้ AI ในการสื่อสาร

- Steve Kramer ที่ปรึกษาทางการเมืองผู้อยู่เบื้องหลัง Robocall กำลังเผชิญกับค่าปรับ 6 ล้านดอลลาร์และข้อหาทางอาญา

- กรณีนี้ถือเป็นครั้งแรกที่มีการใช้ Deepfake ในการเมืองระดับชาติของสหรัฐฯ ส่งผลให้เจ้าหน้าที่ดำเนินการอย่างรวดเร็วและเข้มงวดเพื่อป้องกันการแทรกแซงการเลือกตั้ง

บริษัทโทรคมนาคมแห่งหนึ่งได้ตกลงจ่ายค่าปรับ 1 ล้านดอลลาร์สหรัฐฯ สำหรับบทบาทในการใช้ Deepfake Robocall ที่ปลอมแปลงเสียงของประธานาธิบดี Joe Biden ก่อนการเลือกตั้งขั้นต้นของพรรคเดโมแครตในรัฐ New Hampshire

Lingo Telecom ผู้ให้บริการ Voice Service ที่เผยแพร่ Robocall ที่สร้างจาก AI ผ่านหมายเลขโทรศัพท์ จะจ่ายค่าปรับเจ็ดหลัก และตกลงที่จะมีการกำกับดูแลอย่างเข้มงวดมากขึ้น ทางJessica Rosenworcel ประธาน Federal Communications Commission (FCC) กล่าวในแถลงการณ์ว่า "ทุกคนสมควรได้รับรู้ว่าเสียงที่ได้ยินนั้นเป็นใครกันแน่ หากมีการใช้ AI ก็ควรแจ้งให้ผู้บริโภค พลเมือง และผู้มีสิทธิเลือกตั้งทุกคนที่ได้ยินทราบอย่างชัดเจน"

Robocall นี้ใช้การลอกเลียนแบบเสียงของ Biden ที่สร้างจาก AI ซึ่งบอกผู้มีสิทธิเลือกตั้งใน New Hampshire ไม่ให้ไปลงคะแนนเสียงในการเลือกตั้งขั้นต้นของพรรคเดโมแครตในเดือนมกราคม โดยการโทรนี้ถูกจัดการโดย Steve Kramer ที่ปรึกษาทางการเมืองมานาน ซึ่งในขณะนั้นทำงานให้กับแคมเปญคู่แข่ง แม้ว่า Kramer จะบอกว่าเขาทำเพื่อเป็นการเรียกร้องความสนใจเกี่ยวกับอันตรายของ Deepfake ก็ตาม นายจ้างของKramer ในขณะนั้น ส.ส. Dean Phillips จากพรรคเดโมแครต รัฐ Minnesota ยืนยันว่าไม่มีใครสั่งการ Kramer หรือแม้แต่รู้เห็นในการกระทำของเขา

Kramer กำลังเผชิญกับค่าปรับ 6 ล้านดอลลาร์จาก FCC รวมถึงข้อหาในฐานข่มขู่ผู้มีสิทธิเลือกตั้งและแอบอ้างเป็นเจ้าหน้าที่ในรัฐ New Hampshire ซึ่งเขาได้รับการประกันตัวอยู่ในขณะนี้

นอกจากนี้ Kramer ยังเผชิญคดีแพ่งจาก League of Women Voters ซึ่งกระทรวงยุติธรรมสหรัฐฯ ได้ให้การสนับสนุนคดีนี้เมื่อเดือนที่แล้ว

Kristen Clarke หัวหน้า Civil Rights Division ของกระทรวงยุติธรรมกล่าวในแถลงการณ์ว่า "การข่มขู่ผู้มีสิทธิเลือกตั้ง ไม่ว่าจะดำเนินการด้วยตนเองหรือผ่าน Deepfake Robocall, แคมเปญออนไลน์ที่มีการบิดเบือนข้อมูล หรือกลยุทธ์อื่นๆ ที่ขับเคลื่อนด้วย AI ได้เป็นอุปสรรคสำหรับผู้มีสิทธิเลือกตั้ง ที่ต้องการใช้สิทธิในวิถีประชาธิปไตยของเรา"

Robocall ของ Biden นับเป็นครั้งแรกที่มีการใช้ Deepfake ในการเมืองระดับชาติของอเมริกา ดังนั้นเจ้าหน้าที่จึงเคลื่อนไหวอย่างรวดเร็วและเข้มงวด เพื่อยับยั้ง Deepfake ทางการเมือง ซึ่งแพร่หลายในบางประเทศ นี่ถือเป็นส่งสัญญาณที่ชัดเจนว่าจะไม่ยอมรับการแทรกแซงการเลือกตั้งและเทคโนโลยีที่หลอกลวง

Why it matters

ข้อมูลอ้างอิงจาก Telecom company agrees to $1M fine over Biden deepfake