นักดาราศาสตร์ค้นพบเทคนิคตรวจจับภาพปลอม AI ด้วยเครื่องมือวัดกาแล็กซี

นักวิจัยใช้เทคนิคดาราศาสตร์วิเคราะห์การสะท้อนแสงในดวงตาเพื่อตรวจจับ Deepfake

Key takeaway

- นักวิจัยจาก University of Hull ใช้เทคนิคดาราศาสตร์ในการวิเคราะห์การสะท้อนแสงในดวงตาเพื่อตรวจจับภาพ Deepfake ที่สร้างจาก AI

- เทคนิคนี้ดัดแปลงมาจากเครื่องมือที่ใช้ในการศึกษากาแล็กซี เช่น Gini Coefficient และพารามิเตอร์ CAS เพื่อวัดความสอดคล้องของแสงสะท้อนในดวงตา

- แม้เทคนิคนี้จะมีประสิทธิภาพ แต่ยังมีความเสี่ยงในการให้ผลบวกลวง (False Positive) และอาจไม่สามารถตรวจจับได้หาก AI พัฒนาการสะท้อนแสงที่สมจริงขึ้น

- การตรวจจับภาพ Deepfake เป็นสิ่งจำเป็นในการปกป้องความน่าเชื่อถือของข้อมูลในยุคที่การสร้างภาพจำลองด้วย AI เป็นเรื่องง่าย การใช้เทคนิคใหม่นี้เป็นก้าวสำคัญในการแข่งขันตรวจจับ Deepfake

ในปี 2024 การสร้างรูปภาพจำลองที่สมจริงด้วย AI เป็นเรื่องง่ายดาย ซึ่งทำให้เกิดความกังวลว่าจะตรวจจับรูปภาพหลอกลวงเหล่านี้ได้อย่างไร ล่าสุดนักวิจัยจาก University of Hull ได้เปิดเผยวิธีใหม่ในการตรวจจับรูปภาพ Deepfake ที่สร้างจาก AI โดยการวิเคราะห์การสะท้อนแสงในดวงตามนุษย์ เทคนิคนี้นำเสนอในการประชุม National Astronomy Meeting ของ Royal Astronomical Society เมื่อสัปดาห์ที่แล้ว โดยดัดแปลงมาจากเครื่องมือที่นักดาราศาสตร์ใช้ศึกษากาแล็กซี มาใช้ตรวจสอบความสอดคล้องของแสงสะท้อนในลูกตา

Adejumoke Owolabi นักศึกษาปริญญาโทจาก University of Hull เป็นหัวหน้าทีมวิจัยภายใต้การดูแลของ Dr. Kevin Pimbblet ศาสตราจารย์ด้านฟิสิกส์ดาราศาสตร์

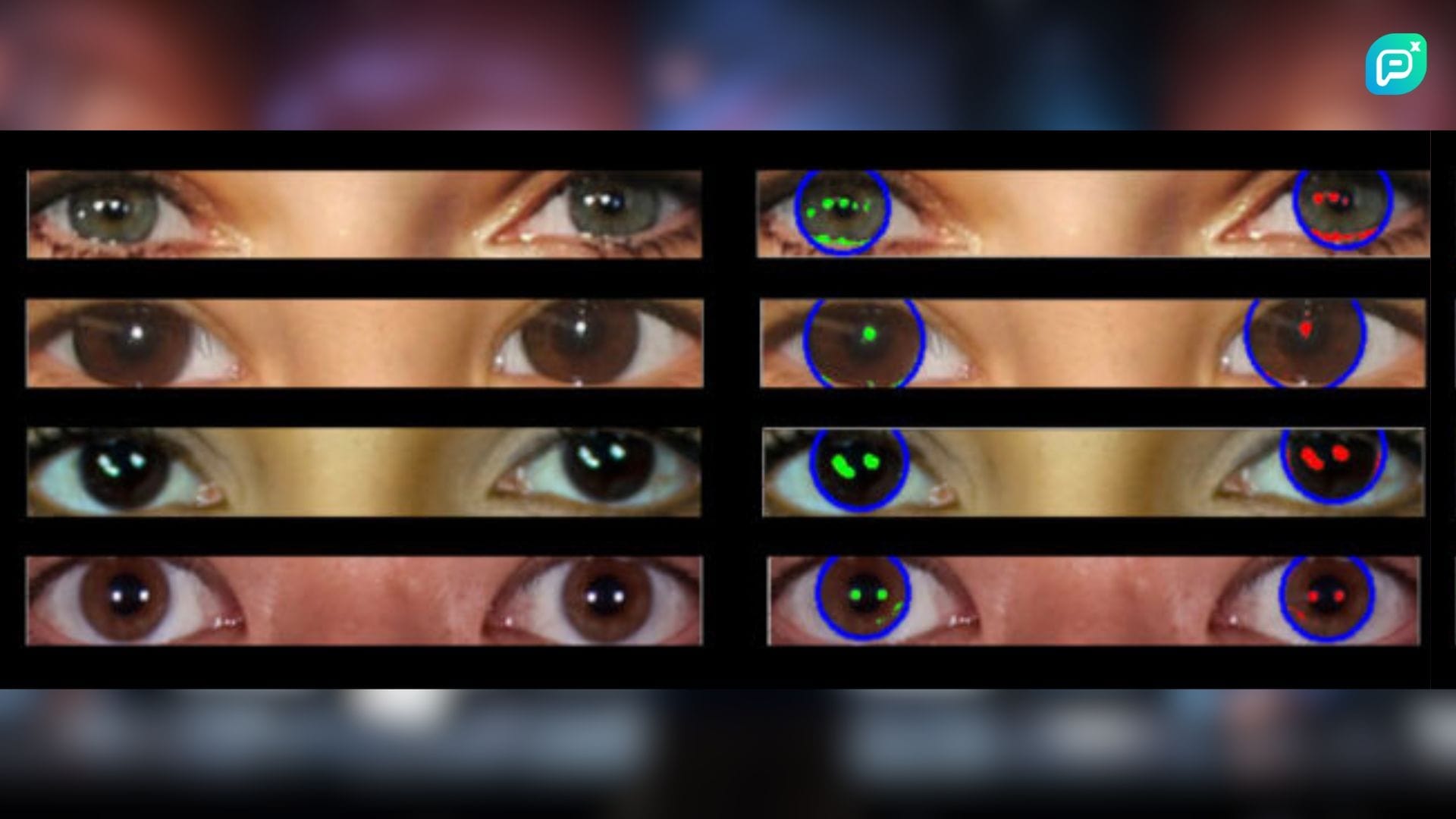

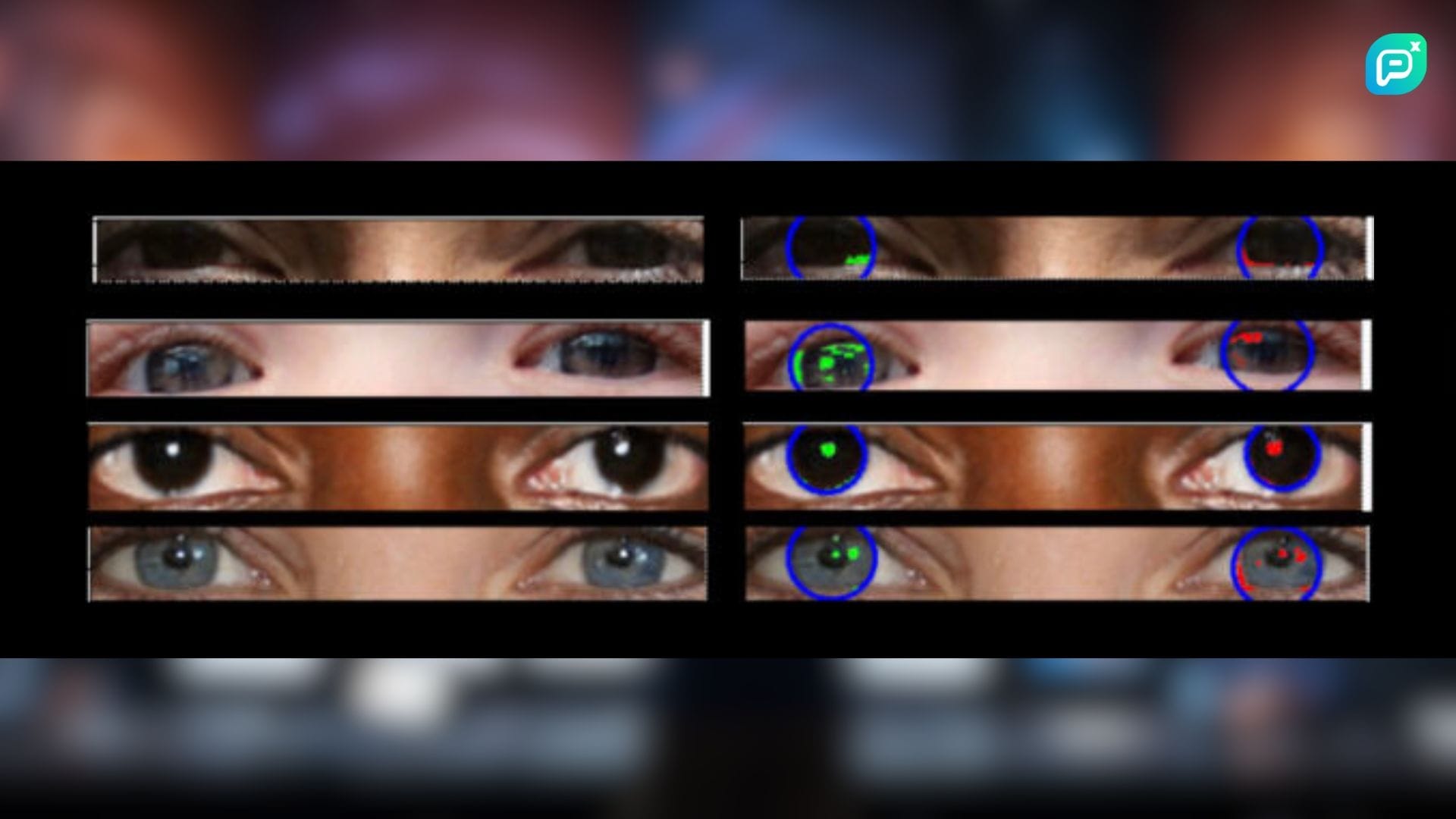

เทคนิคการตรวจจับนี้อาศัยหลักการง่ายๆ คือ ดวงตาทั้งคู่ที่ถูกส่องสว่างด้วยแหล่งกำเนิดแสงเดียวกัน มักจะมีรูปแบบการสะท้อนแสงที่คล้ายคลึงกันในแต่ละลูกตา แต่รูปภาพที่สร้างจาก AI หลายรูปที่ผลิตออกมาจนถึงปัจจุบัน ไม่ได้คำนึงถึงการสะท้อนแสงของลูกตา ดังนั้นการสะท้อนแสงจำลองมักจะไม่สอดคล้องกันระหว่างดวงตาแต่ละข้าง

ในบางแง่มุม มุมมองทางดาราศาสตร์อาจไม่จำเป็นสำหรับการตรวจจับ Deepfake แบบนี้เสมอไป เพราะการมองผ่านๆ ที่ดวงตาในรูปภาพก็สามารถเปิดเผยความไม่สอดคล้องของการสะท้อนแสงได้ ซึ่งเป็นสิ่งที่ศิลปินที่วาดภาพเหมือนต้องคำนึงถึง แต่การประยุกต์ใช้เครื่องมือทางดาราศาสตร์เพื่อวัดและประเมินการสะท้อนแสงของดวงตาใน Deepfake โดยอัตโนมัตินั้น ถือเป็นการพัฒนาใหม่

การตรวจจับอัตโนมัติ

ในโพสต์บล็อกของ Royal Astronomical Society Dr. Pimbblet อธิบายว่า Owolabi ได้พัฒนาเทคนิคในการตรวจจับการสะท้อนแสงของลูกตาโดยอัตโนมัติ และนำคุณลักษณะทางสัณฐานวิทยาของการสะท้อนแสงไปผ่านดัชนีต่างๆ เพื่อเปรียบเทียบความคล้ายคลึงกันระหว่างลูกตาซ้ายและขวา ผลการค้นพบเผยให้เห็นว่า Deepfake มักแสดงความแตกต่างระหว่างดวงตาทั้งคู่

ทีมวิจัยประยุกต์ใช้วิธีการจากดาราศาสตร์เพื่อวัดและเปรียบเทียบการสะท้อนแสงของลูกตา พวกเขาใช้ Gini Coefficient ซึ่งปกติใช้วัดการกระจายแสงในภาพกาแล็กซี เพื่อประเมินความสม่ำเสมอของการสะท้อนแสงในพิกเซลของดวงตา ค่า Gini ที่ใกล้เคียง 0 บ่งชี้ถึงการกระจายแสงที่สม่ำเสมอ ในขณะที่ค่าที่ใกล้เคียง 1 แสดงถึงแสงที่กระจุกตัวอยู่ในพิกเซลเดียว

นอกจากนี้ นักวิจัยยังได้สำรวจการใช้พารามิเตอร์ CAS (Concentration, Asymmetry, Smoothness) ซึ่งเป็นอีกหนึ่งเครื่องมือจากดาราศาสตร์ในการวัดการกระจายแสงของกาแล็กซี อย่างไรก็ตาม วิธีนี้พิสูจน์แล้วว่าใช้ได้ผลน้อยกว่าในการระบุดวงตาปลอม

การแข่งขันตรวจจับที่ไม่มีที่สิ้นสุด

แม้ว่าเทคนิคการสะท้อนแสงของดวงตาจะเป็นแนวทางที่มีศักยภาพในการตรวจจับรูปภาพที่สร้างจาก AI แต่วิธีนี้อาจใช้ไม่ได้ผลหากโมเดล AI มีวิวัฒนาการไปสู่การใช้การสะท้อนแสงดวงตาที่ถูกต้องตามหลักฟิสิกส์ ซึ่งอาจนำมาประยุกต์ใช้เป็นขั้นตอนถัดไปหลังจากการสร้างภาพ นอกจากนี้ เทคนิคดังกล่าวยังต้องการมุมมองระยะใกล้ที่ชัดเจนของลูกตาจึงจะใช้งานได้

วิธีนี้ยังมีความเสี่ยงที่จะให้ผลบวกลวง (False Positive) เนื่องจากแม้แต่รูปถ่ายจริงก็สามารถมีการสะท้อนแสงของดวงตาที่ไม่สอดคล้องกันได้ เนื่องจากสภาวะแสงที่แตกต่างกันหรือเทคนิคการตกแต่งภาพหลังการถ่าย แต่การวิเคราะห์การสะท้อนแสงของดวงตาอาจยังคงเป็นเครื่องมือที่มีประโยชน์ในชุดเครื่องมือตรวจจับ Deepfake ขนาดใหญ่ ที่พิจารณาปัจจัยอื่นๆ ด้วย เช่น พื้นผิวของเส้นผม กายวิภาค รายละเอียดของผิวหนัง และความสอดคล้องของพื้นหลัง

แม้ว่าเทคนิคนี้จะดูมีแนวโน้มที่ดีในระยะสั้น แต่ Dr. Pimbblet ก็เตือนว่ามันไม่ได้สมบูรณ์แบบ "มันมีทั้ง False Positive และ False Negative มันจะไม่ตรวจจับได้ทุกอย่าง" เขากล่าวกับ Royal Astronomical Society "แต่วิธีนี้ให้พื้นฐานแก่เรา เป็นแผนการโจมตีในการแข่งขันอาวุธเพื่อตรวจจับ Deepfake"

Why it matters

ข้อมูลจาก